¿Qué es la entropía?

La entropía es un concepto fundamental en la termodinámica y en la física en general. La primera noción de entropía se desarrolló en el siglo XIX como una medida de desorden en un sistema físico y ha llegado a ser crucial para entender procesos naturales y artificiales. Sin embargo, este concepto tan intrincado puede parecer complejo al principio. En este artículo, desglosaremos la entropía en sus componentes más esenciales y exploraremos su significado, aplicaciones y ramificaciones en diversos campos de la ciencia.

Definición de Entropía

Termodinámica y Entropía

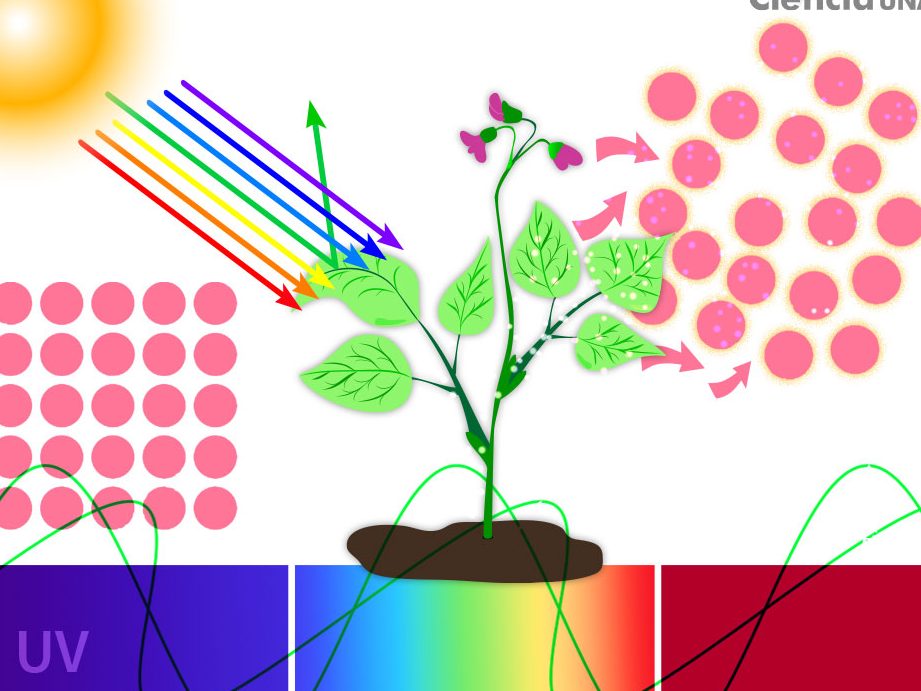

En el contexto de la termodinámica, la entropía es una medida del desorden o aleatoriedad en un sistema. Se interpreta como el grado de incertidumbre o dispersión de la energía en un sistema cerrado. La Segunda Ley de la Termodinámica establece que la entropía de un sistema aislado tiende a aumentar con el tiempo, lo que implica que los procesos naturales espontáneamente favorecen estados con mayor desorden.

La entropía no sólo mide el desorden, sino que también cuantifica la eficiencia de las transformaciones energéticas.

Podemos ver esta tendencia hacia el desorden en diversos fenómenos naturales como la expansión de gas en un contenedor, la evaporación de líquidos y otros procesos irreversibles.

Entropía en Información

En la teoría de la información, la entropía se refiere a la medida del nivel de incertidumbre o sorpresa asociado con un conjunto de datos. Claude Shannon, el padre de la teoría de la información, definió la entropía informacional en su trabajo seminal en 1948. Aquí, la entropía cuantifica la cantidad de información necesaria para describir el estado de un sistema o comunicar un mensaje.

- Reducción de Incertidumbre: Cuanto mayor es la entropía, mayor es la incertidumbre y, por lo tanto, más información se requiere para describir el sistema completamente.

- Compresión de Datos: La entropía proporciona un límite inferior teórico para la compresión de datos. Un sistema con alta entropía puede ser menos susceptible a una compresión efectiva.

Importancia de la Entropía

Aplicaciones en la Física

El concepto de entropía es crucial para entender muchas aplicaciones físicas fundamentales, desde el comportamiento de partículas subatómicas hasta los ciclos de vida de las estrellas. Por ejemplo:

- Física Estadística: La entropía ayuda a prever el comportamiento macroscópico de sistemas formados por un gran número de partículas.

- Cosmología: La entropía del universo está en constante aumento, lo que tiene implicaciones para la evolución y destino del cosmos.

Aplicaciones en el Día a Día

La entropía también juega un papel importante en nuestra vida cotidiana. Algunos ejemplos incluyen:

- Procesos de Cocción: Cocinar implica cambios en la estructura molecular de los alimentos, lo cual está guiado por principios de entropía.

- Señales de Comunicación: La optimización de redes de comunicación y la codificación de datos se basan en el concepto de entropía para minimizar los errores y maximizar la eficiencia.

¿Por qué es importante la entropía en la termodinámica?

La entropía es de crucial importancia en la termodinámica por varias razones. En primer lugar, ayuda a entender la dirección en la que ocurren los procesos naturales. De acuerdo con la Segunda Ley de la Termodinámica, la entropía de un sistema aislado no disminuye; esto nos dice intuitivamente que los procesos naturales son irreversibles y siempre tienden hacia un estado de mayor desorden.

Relación con la Energía

Otra razón fundamental es que la entropía está directamente relacionada con la eficiencia de los ciclos termodinámicos. En un motor térmico, por ejemplo, la cantidad de trabajo útil que se puede extraer está limitada por el aumento de entropía. Cuanto mayor es la entropía producida, menos eficiente es el proceso.

Principio de Equilibrio

La entropía también proporciona una condición necesaria y suficiente para que un sistema alcance el equilibrio termodinámico. Un sistema está en equilibrio termodinámico si y sólo si su entropía es máxima, dado que en ese estado no hay transferencia neta de energía.

¿Cómo se mide la entropía?

Medir la entropía puede ser un desafío porque no es una cantidad tangible, pero se han desarrollado métodos y fórmulas para este propósito. La fórmula de Boltzmann, S = kB ln Ω, es una forma fundamental de medir la entropía donde kB es la constante de Boltzmann y Ω es el número de microestados posibles de un sistema.

Entropía en Procesos Isotérmicos

En procesos isotérmicos, es decir, aquellos que ocurren a temperatura constante, la entropía se puede medir a través de la transferencia de calor dividida por la temperatura (dS = δQ/T).

Calorimetría

En entornos de laboratorio, la calorimetría es una técnica donde se mide el calor transferido en un proceso para calcular la variación de entropía. La ecuación básica en este caso es ΔS = ∫ (δQ/T).

| Curiosidad | Descripción |

|---|---|

| Paradoja de Loschmidt | Se cuestiona si la naturaleza irreversible de la entropía contradice las leyes de la física que son simétricas en el tiempo. |

| Entropía Negativa | Erwin Schrödinger propuso que los organismos vivos disminuyen su entropía interna expulsando "entropía negativa". |

Preguntas Frecuentes

A continuación, respondemos algunas de las preguntas más frecuentes sobre la entropía.

Deja una respuesta

Contenido interesante